第一作者简介:王怡,女,山西临汾人,硕士研究生,研究方向为声像资料检验。E-mail: 864044175@qq.com

深度伪造(Deepfake)是一种将图像篡改与AI相结合的面部替换方法。本文首先介绍了Deepfake的产生背景和发展状况,介绍了相应检测技术的研究状况,并对相关文献进行归纳;然后探究了Deepfake运行的基本构架和核心部件,给出了视频面部替换的基本流程和步骤,并阐释了利用自编码网络进行脸部图像训练和转换的原理;最后,从视频的基本信息、编辑痕迹、违背摄影规律、视频整体和案情五个方面与原始视频作对比,分析这类伪造视频存在的问题。深度伪造技术在推动娱乐和文化发展的同时也产生了大量恶意的换脸视频,对国家安全、社会稳定和个人隐私造成潜在的威胁,本文通过对Deepfake实现原理的研究和伪造视频特征的分析,希望能够为该类视频的真伪检验提供一定的理论支持。

Cyber deep learning technology is progressing so that Deepfake, one most influential facial editing software, gets plenty of substantial applications for manipulation. Such a face-swapping artifice combines the image tampering with AI (artificial intelligence) innovation, able to replace one video face with another under no change of the expression, movement and background of the original character. Deepfake has greatly reduced the difficulty to tamper facial images, resulting in numerous fake videos appearing. Consequently, crimes are increasingly involved with these affairs on/off networks. With introduction to Deepfake at the beginning, this paper elucidated about the relevant technologies on their context and development, carrying on the literature-based summarization, illustrating Deepfake from its basic framework, kernel structures to basic course and steps of video facial replacement, explaining the principle on how to drill and transform the facial images through autoencoding the built-in neural network into improving the generated image’s quality with the modified Autoencoder Network combined of GAN (generative adversarial nets). Finally, the comparison was made between the fake and original videos from five aspects: basic information, video editing signs, inconformity against the photographic routines and norms, video-audio contradiction, image identification and case truth, having disclosed the problems caused or existing in the fake videos. Malicious fake videos produced from Deepfake certainly pose potential threats to national security, social stability and personal privacy. Therefore, this paper may provide some theoretical support and practical reference for examining whether one video is real or fake.

深度伪造(Deepfake)是现在应用比较广泛的面部替换技术, 最初是由Reddit一个名为“ Deepfakes” 的用户开发的, 他利用公开的视频、图像, 将名人的脸替换在色情视频中。换脸技术曾由于对专用设备和操作人员的高要求, 仅限于少数人使用, 而Deepfake的出现大大降低换脸门槛。随着可访问的开源代码(如Deepfacelab和Faceswap)以及OpenFace-Swap和FakeApp (官方网站已经禁止, 但各大交流平台仍有传播)等应用程序的传播和不断改进, 数字视频的伪造变得越来越容易, 大量的合成的换脸视频出现在社交媒体和新闻中, 这些视频被称为“ Deepfake videos” 。

2018年底荷兰Deeptrace实验室发布了一份Deepfake的发展报告[1]显示:截至2018年12月, Deepfake每月的谷歌全球搜索量已稳定到多达100万, 伪造视频至少有14 678个, 其中涉及色情信息的占比高达96%, 还有涉暴、政治敏感、广告、违禁品等风险内容伪装在视频中。这些恶意的换脸视频触及法律底线, 衍生各种违法犯罪活动。视频、图像是一种重要的证据, 是犯罪认定的重要依据, 而AI换脸的出现, 无疑是对其客观真实性的一大冲击。因此, 本文对这项技术的相关问题进行探讨, 分析如何判别视频内容和人物真假。

Deepfake技术的发展也催生了相应检测技术的诞生, Yuezun Li等[2]使用了一种深度神经网络模型, 将卷积神经网络CNN和递归神经网络相结合, 形成长短期记忆网络即Lrcn网络, 认为假视频一般不会表现出眨眼、呼吸和眼球运动这些特征, 由此检测出图像或视频中的脸是真实的还是AI生成的; Matern等[3]提出利用图像伪影检测面部伪造; Yuezun Li等[4]通过训练CNN来检测换脸视频中出现的这种面部伪影; Haodong Li等[5]利用真实图像和面部伪造图像在颜色分量上的差异来区分真伪; Yang等[6]提出基于头部姿势与重要五官标志位置不匹配的SVM支持向量机分类方法; Koopman等[7]预测面部区域的篡改会影响视频帧中局部光照响应不一致性噪声, 并证明该噪声可以用来区分原始视频和换脸视频, 但要对更大的数据集进行研究才能确定二者的相关性; 由于FakeApp生成Deepfake假视频时, 会导致帧内不一致和帧间时间不一致, Guera等[8]提出运用递归神经网络来检测视频的这种异常; Afchar等[9]提出用两种低层数的神经网络进行检测的方法; Korshunov等[10]评估了几种检测方法的可靠性, 提出:最先进的VGG和基于Facenet的神经网络人脸识别算法无法将换脸视频与原始视频区分开来, 基于唇形和语音不一致的检测算法无法区分Deepfake伪造视频, 而基于支持向量机分类的图像质量检测技术可以检测出高质量(128× 128)的换脸图像, 误差较低。

Deepfake是用无监督学习的方式训练一个神经网络, 将扭曲的脸部图像编码后重新生成原始输入, 并且期望这个网络具备将任意人脸还原的能力。实现Deepfake换脸的整体流程如图1左所示, 即最终实现FaceA替换视频或图像中的FaceB。首先从视频或图片集中获取具有A/B脸的图像, 进行人脸检测、人脸对齐。具体来说, 在人脸检测的基础上, 进行面部关键特征的定位, 通过仿射变换将检测到的人脸归一化和对齐, 可以截取半脸或全脸的人脸面部图像; 然后将截取的A/B脸图像送入神经网络进行训练、转换, 获得具有B表情、动作、环境等条件的A脸, 再将输出的人脸图像覆盖到原始图像(如图1右), 平滑边缘后重新合成视频。

Deepfake的核心部件是一种神经网络, 称为自动编码器(Autoencoder)(如图2)。自动编码器是一种前馈神经网络, 采用反向传播方式进行训练, 其可以看作编码器(Encoder)和解码器(Decoder)的链接。其中编码器的目的是将输入层的数据压缩编码以减少变量数来进行降维。解码器的目的是将变量输出为原始输入的近似值, 通过不断压缩编码和恢复重建使得网络学习到图像的本质特征。用损失函数(Loss function)来判断这个转化的好坏, 采用均方误差(公式如下), 模型的训练过程就是最小化Loss值的过程。

x为输入, x′ 为输出, 公式表示这一过程即:

x′ =Decoder(Encoder(x)) Loss=(x- x′ )2

其核心思想是:在训练部分, 对A、B脸的编码共用一个编码器E但保持各自解码器D的分离。

首先对输入图像进行扭曲处理(Shuffle), 提升网络的学习能力, 共享EA和EB编码部分的权重, 将扭曲后的A、B脸的图像用这个共享编码器进行压缩编码, 用各自解码器进行解码恢复成正常图像, 即从扭曲脸A中重构出A的脸, 从扭曲脸B中重构出B的脸[11]。在转换部分, 只需将B脸看作“ 扭曲” 的A脸送入编码器, 用A的解码器进行还原, 即可得到具有B背景条件和表情的A脸。一旦优化完成, 编码器可以学习到A、B的光照、姿态、表情等一般特征, 通过A、B各自的解码器还原脸部的个性特征[3, 8, 9]。这一原理如图3所示。

3.1.1 查看视频文件参数信息

对于同一个设备拍摄的文件, 当拍摄设备的参数设置未发生变化, 获取样本视频, 用相应的视频播放器打开时, 检材视频与样本文件的参数信息应当保持一致。因此可使用录制检材视频的拍摄设备再录制样本视频, 用相同播放器打开, 对比二者信息属性。

3.1.2 分析视频文件的十六进制数据信息

十六进制信息所对应的 ASCII 字符可以发现视频中后期编辑软件遗留信息[12]。Fakeapp或Deepfacelab程序中, 通常用ffmpeg将换脸图片按照目标视频的图片序列重新合成视频, 因此在其ASCII信息中可观察到ffmpeg程序的libavformat标准值“ Lavf” 及其版本编号(如图5)[13]; 当使用爱剪辑、Premiere、会声会影等主流视频编辑软件对视频进行再编辑修改时, 会对视频文件中包含的特定结构进行修改。通过分析视频文件的十六进制信息中数据的存储结构, 以及每个特定结构中存储的关键性参数信息可以鉴别视频真伪(如图5)。

反复查看视频, 查找视频中可疑帧图像。对视频画面人脸边缘轮廓、不同部位的反差、影调等进行检验, 是否存在局部缺陷、重影、闪烁等异常现象。检材视频中的人脸可从以下方面进行分析检验。

3.2.1 眼睛

观察检材视频中的人眼是否缺乏眨眼或存在异常眨眼。自发眨眼是在没有外界刺激和内部努力的情况下眼睑的快速闭合和张开运动, 是人体的自然生理反应, 正常人每次眨眼时长为0.1~0.4 s, 间隔2~10 s, 真实视频中可观察到上述频率和持续时间的自发眨眼[2]。Deepfake的训练是基于大量的人脸图像, 而在网上获取的半闭眼和闭眼图像少, 所以眨眼的缺失、闭眼不完全是伪造视频的一个标志。从单帧图像序列中可观察到, 视频中人物在整个眨眼过程中闭眼不规律(如图6左)。

眼睛镜反射缺失或异常。镜反射在眼睛中是最明显的, 正常情况下视频中眼睛镜反射的形状和位置与现场光源分布是对应的。而由Deepfake技术产生的伪造视频中眼睛的镜反射不是消失了就是被简化为白色斑点[3, 14], 瞳孔颜色较黑, 眼睛黯淡无神(如图6右)。

在Deepfake算法中, 模型通常是从数据中隐式学习, 对光照估计不精确, 会导致面部伪影出现; 由于原来的图像是被新的面罩覆盖, 如果底层几何学估计不精确, 伪影也会沿着面具的边界出现。这些伪影通常表现在鼻子区域、脸颊和眉毛周围(如图7), 呈现出异常边缘特征或高对比度的斑点。

此外, 一些遮挡面部的部分, 如头发, 没有正确地建模可能会出现“ 孔洞” 。由于牙齿没有模型, 导致在社交媒体上的Deepfake视频中经常出现一些图像细节的缺失, 即牙齿整体模糊黯淡, 以单一的白色点状出现, 而不是单个的牙齿, 有时牙齿上也会有伪影的出现。

3.2.3 肤色

在有限的编码空间内, 自动编码器对原有图像压缩重建过程中必然存在信息的丢失, 损失函数恒为正; 通过编码器权值共享获取AB的共同特征, 比单独学习A的特征信息损失要更为严重。这两方面原因都会使替换后的人脸分辨率降低。

另一方面, 不同人的肤色差异, 图像分辨率的差异, 普通用户承受不起太大的数据集使得神经网络学习不够, 导致融合后的人脸不同部位表现出“ 色差” , 即接缝融合产生的边界很常见, 脸部五官区域和边缘皮肤细节有较大差异(如图8), 因此只能通过模糊处理让融合更自然。这样一来, 替换后的人脸损失大量的面部细节信息, 脸部明显失真, 与周围图像的清晰部分形成反差。增大编码空间虽然使得面部细节得以表现, 但人脸的形态学数据也会被传到解码器, 使重构后的人脸相似于输入方, 而成为二者的“ 融合体” 。

3.2.4 脸型

在Deepfake算法中, 神经网络提取、训练包括脸型在内的脸部区域, 效果要差于只提取、训练脸局部区域, 即额头、下颌都不在训练图片内, 然后再根据网络输出覆盖原图部分。因此在社交媒体中的绝大多数视频中, 可以发现很多替换人脸后的视频仍保留原视频的脸型轮廓、耳形, 该特征在下颌部分尤其突出。在替换全脸的伪造视频中, 可能留有遮罩覆盖的边缘特征(如图9)。

3.2.5 五官位置

Deepfake技术在人脸对齐时标记68处脸部特征点, 参考二维坐标系位置信息记录其坐标点, 通过仿射变换进行人脸归一化和对齐。仿射变换基于左眼、右眼、嘴三个特征点确定变换矩阵M, 再将转换后的FaceA通过矩阵M-1转换回原始人脸进行融合。

Deepfake是将合成的人脸区域逆变换到原始图像中而产生的, 这一过程要从二维面部图像中估计3D头部姿态, 由于不同人有不同的面部结构, 面部融合时不能保证两张脸完全特征匹配, 因此会产生一些误差, 这种误差会通过一些异常现象反映出来, 表现为一些重要五官标志如眼睛、鼻尖、嘴的朝向与头部姿势不符(图10)[6], 或五官在整个面部的位置、比例异常。

3.2.6 侧脸、遮挡脸

这项技术并不是完美无缺的, 人脸的提取和重新融合可能会失败, 特别是在各种大角度侧脸、面部遮挡的情况下。人脸定位时, 基于特征标记的算法对倾斜脸的检测效果不好, 导致一些帧人物侧脸并没有被替换, 或缺失面部表情, 或有较大的模糊区域或者边缘模糊、重影。

3.2.7 面部连贯性

该面部篡改方法中, 自动编码器是逐帧处理的, 并不知道之前已经生成的脸。由于人脸检测的不精确, 有限数据训练的自动编码器不能正确还原人物面部光照, 会导致假视频在面部区域出现闪烁、抖动现象[8, 15]。

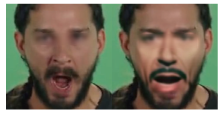

除以上七点外, 换脸后的视频相较于原视频, 还表现出以下特征:人物表情所要传达的情感大大减弱[5], 甚至有些不自然(如图11); 眼、唇、鼻等五官缺乏脸部肌肉, 没有立体感; 合成人脸面部色温的变化。

说明:本文图1右、6、7、8、10源于数据集Deepfake in the wild:https://github.com/deepfakeinthewild/deepfake_in_the_wild。图9、11来源于Faceswap:https://github.com/joshua-wu/deepfakes_faceswap。

3.3.1 违背景深规律

根据景深关系, 无论图像还是视频, 都只存在一个影像中心, 即只有一个最清晰平面和固定景深, 离对焦点越近, 影像越清晰; 反之, 影像越模糊。由Deepfake形成的合成视频中, 由于脸部是替换形成的, 被替换部位图像的清晰程度与原始图像的清晰程度有差异, 这种差异使得合成图像明显违背景深规律。

3.3.2 违背光影规律

由于肤色、光照条件、拍摄设备的差异, 不同的视频、图像间也存在很大的差别, 编解码器无法在所有条件下都还原出真实的人脸[16]。因此, 伪造形成的面部光影表现无法完全匹配原始视频的背景条件。在一些深度伪造视频中, 违背光影规律表现在:视频背景中的光质强, 而替换后的面部仍表现为处于弱光质条件下, 没有形成阴影; 或者面部存在明暗变化, 但阴影的方向、强度与光照条件不符。

3.4.1 通过人像检验进行鉴别

一些恶意视频的篡改, 通常是借助名人效应、政治影响力以实现其非法目的。这种情况下, 可将视频中可疑人物的图像作为检材, 可获取到的实际人物照片作为样本, 通过特征测量、画线比对、相片重合等方法进行检验, 特别要注意一些面部特殊标志, 如创口、痣等, 合成后的人脸可能造成此类细节特征的消失, 且由于自动编码器是逐帧处理, 一些面部细节特征可能会在某些帧中消失, 特征表现不连贯。

3.4.2 声音是否一致

视频中替换后人物的声音与现实人物声音不一致, 通过声纹鉴定可确定视频中的声音是否来源于目标人物。

3.4.3 声像是否同步

Deepfake生成换脸后的图像, 按照原始帧顺序重新合成视频, 没有形成同步声音。造假者后期使用一些编辑软件(如ffmpeg、Premiere等), 重新加入原视频的音频, 这一过程由于音像不同步, 伪造视频中可能出现说话人唇型与文本不一致的现象。

从现实角度分析, 视频中目标人物有无做出某种事或说出某些话的可能。从人物整体分析, 分析人脸外的其他特征, 如身材(如身高、胖瘦、身材比例等)、体态、行为特征、所处背景环境与实际人物信息是否符合。从侦查角度对视频来源进行追踪调查, 通过对视频发布者的调查确定视频真伪。

目前, 针对Deepfake技术的多种深度伪造检测方法, 由于可扩展性和稳定性无法满足实务中的需求, 还无法应用于视频图像的检验鉴定。因此, 对于这类伪造视频, 可以从眨眼, 纹理特征, 五官位置, 面部轮廓变化, 视频连贯性, 人物的面部表情与动作、声音等特征, 综合视频的基本信息、视频整体表现, 案情等多个角度进行分析检验。

Deepfake技术依托于人工智能, 正飞速向前发展, 如采用卷积神经网络进行脸部图像识别, 使人脸的检测更加稳定; 加入眼球检测, 使其在更短时间内生成与输入人脸更为一致的眼球运动; 模型加入遮挡处理, 消除人为干扰等, 这些进步对伪造视频的检验又提出了更高的要求。技术本无罪, 但恶意的伪造内容借助移动互联网被迅速传播, 对网络安全、信息安全、社会安全均带来了巨大的隐患。所以, 研究切实可行的深度伪造技术检验方法和检测技术是无法避免且急需解决的问题。

| [1] |

|

| [2] |

|

| [3] |

|

| [4] |

|

| [5] |

|

| [6] |

|

| [7] |

|

| [8] |

|

| [9] |

|

| [10] |

|

| [11] |

|

| [12] |

|

| [13] |

|

| [14] |

|

| [15] |

|

| [16] |

|